既然我們已經深入到企業級本地 AI 的戰略與架構,那麼我們必須談談支撐這一切的硬體核心——也就是您提到的 NVIDIA A100 與 H100 等高效能 GPU。

在 AI 的世界裡,運算能力(Compute Power)就是貨幣。而這些資料中心級的 GPU,就是這個領域的「金條」。

我們將從技術規格、適用場景,以及企業該如何選擇這三個維度來剖析這些設備。

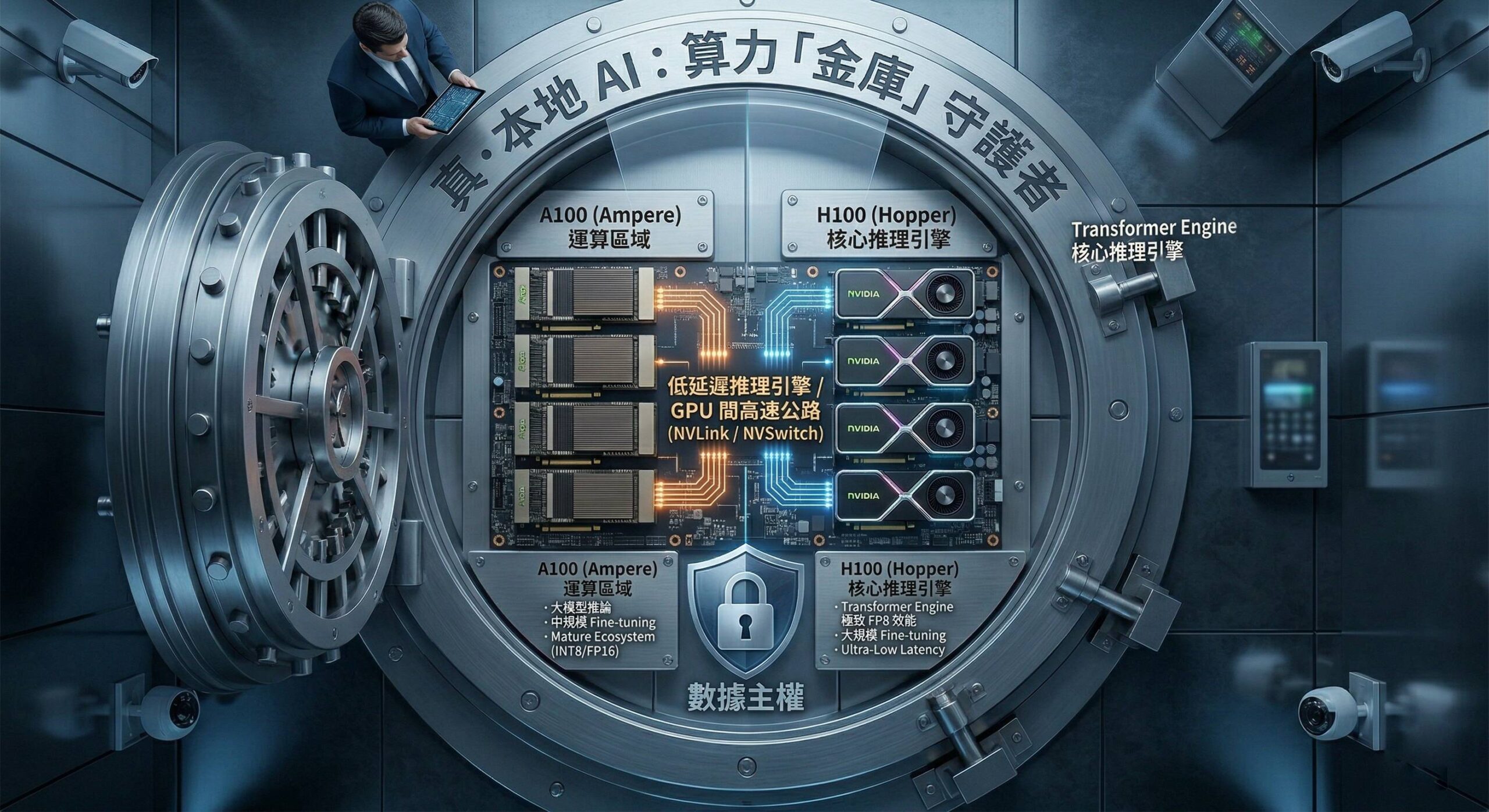

設備層面的硬核剖析:NVIDIA A100 vs. H100

要運行企業級的模型(尤其是 70B 參數以上的 LLM)並支持多用戶併發訪問,家用級的 RTX 4090 已經不足以應付,您需要的是**資料中心級(Datacenter-class)**的硬體。

1. 核心技術指標:我們在看什麼?

在評估這些晶片時,我們不能只看遊戲顯示卡的指標,而是要看專為 AI 優化的關鍵技術:

- Tensor Cores(張量核心):這是專為矩陣運算(AI 的核心運算)設計的硬體加速器。H100 擁有第四代 Tensor Cores,效率遠超前代。

- HBM(High Bandwidth Memory, 高頻寬記憶體):AI 模型需要以極快的速度載入和交換數據。HBM 提供了遠超一般 DDR 或 GDDR 記憶體的頻寬。

- NVLink / NVSwitch:這是 GPU 之間的「高速公路」。當您將多張 GPU 組合在一起時(例如一張伺服器裝 8 張),NVLink 讓它們能像一張超級 GPU 一樣協同工作,頻寬遠超 PCIe 介面。

- Transformer Engine(變壓器引擎,H100 專屬):這是 H100 的殺手鐧。它能在不顯著損失精度的情況下,動態調整運算精度(例如從 FP16 轉為 FP8),從而使 Transformer 架構的模型(如所有主流 LLM)的推論與訓練速度大幅提升。

2. 進階設備對比:Ampere 與 Hopper 的決鬥

NVIDIA A100 Tensor Core GPU (Ampere 架構)

這款晶片是 AI 時代的「一代宗師」,雖然有了繼任者,但在本地部署中依然極具價值。

- 優勢:

- 成熟穩定:生態系統極其成熟(Cuda, ML frameworks)。

- 大容量 VRAM:80GB HBM2e 的版本能容納龐大的模型。

- 高性價比(相對):隨著 H100 的普及,A100 在二手或翻新市場的價格變得更具吸引力,非常適合中型企業的初期部署。

- 適用場景:

- 大模型推論:部署 FP16 或 INT8 量化的 70B-100B 模型。

- 中小規模微調:針對企業數據進行 Fine-tuning(如 RAG 知識庫的嵌入模型微調)。

- 多用途運算:A100 的通用運算能力依然頂級,也適用於傳統的 HPC 任務。

NVIDIA H100 Tensor Core GPU (Hopper 架構)

這是目前的「算力之王」,專為 LLM 和大規模 AI 訓練而生。

- 優勢:

- 極致效能:得益於 Transformer Engine,H100 在 LLM 推論和訓練上的速度可達 A100 的 3 到 6 倍(取決於具體任務)。

- HBM3 記憶體:提供近乎翻倍的記憶體頻寬(達 3TB/s),徹底消除數據吞吐瓶頸。

- NVLink 4.0:GPU 間的連線頻寬大幅提升。

- 適用場景:

- 大規模 Fine-tuning 與訓練:如果您需要從頭訓練模型,或對極大模型進行全參數微調。

- 高併發、極低延遲推論:企業級 RAG 系統若需支撐數千人同時使用,且要求毫秒級回應,H100 是唯一選擇。

- 未來防護:它是目前最強大的晶片,能確保您的硬體在未來數年內不落伍。

3. 企業決策者的硬體選擇策略

面對這些動輒數十萬港幣一張的「金條」,我們該如何選擇?這取決於您的核心需求與預算:

策略 A:預算有限,重在落地 (性價比優先)

- 選擇:NVIDIA A100 (80GB VRAM) 伺服器 (通常是 4 GPU 或 8 GPU 配置)。

- 理由:80GB 的 VRAM 足以部署量化後的 Llama 3 70B。利用 NVLink,4 張 A100 的組合能提供極佳的推論效能,足以應付一家中型企業的 RAG 知識庫查詢需求。

- 優勢:初期資本支出(CAPEX)顯著低於 H100,且技術成熟度高。

策略 B:追求極致效能與未來擴展 (效能與未來優先)

- 選擇:NVIDIA H100 伺服器 (通常是 HGX H100,內含 8 張 H100 80GB HBM3)。

- 理由:如果您需要為整個集團提供 AI 服務,或需要頻繁微調模型以適應快速變化的業務,H100 的 Transformer Engine 和 HBM3 的頻寬將提供無可比擬的優勢。

- 優勢:單機算力最強,能處理最複雜的模型,營運效率最高(每 Token 的能耗可能更低)。

策略 C:混合部署 (針對特定任務優化)

- 選擇:在同一個資料中心內,部署少量 H100 用於最核心、對延遲最敏感的任務(如即時客戶對話),部署較多 A100 用於後台的批次數據處理或嵌入模型運算。

- 理由:更靈活的成本控制。

結語:不只是晶片,而是整個系統

在設備層面,不僅僅是在買晶片,是在買一套智慧基礎設施(Intelligent Infrastructure)。這些 GPU 需要專門的伺服器架構(如 NVIDIA HGX 系統)、極高頻寬的網路連接(如 InfiniBand 或 400GbE 乙太網)、強大的電力供應以及液冷或強效風冷系統。

發佈留言